本文写给:想动手搭建AI agent赋能的信息处理中台「包括投研中台」的你

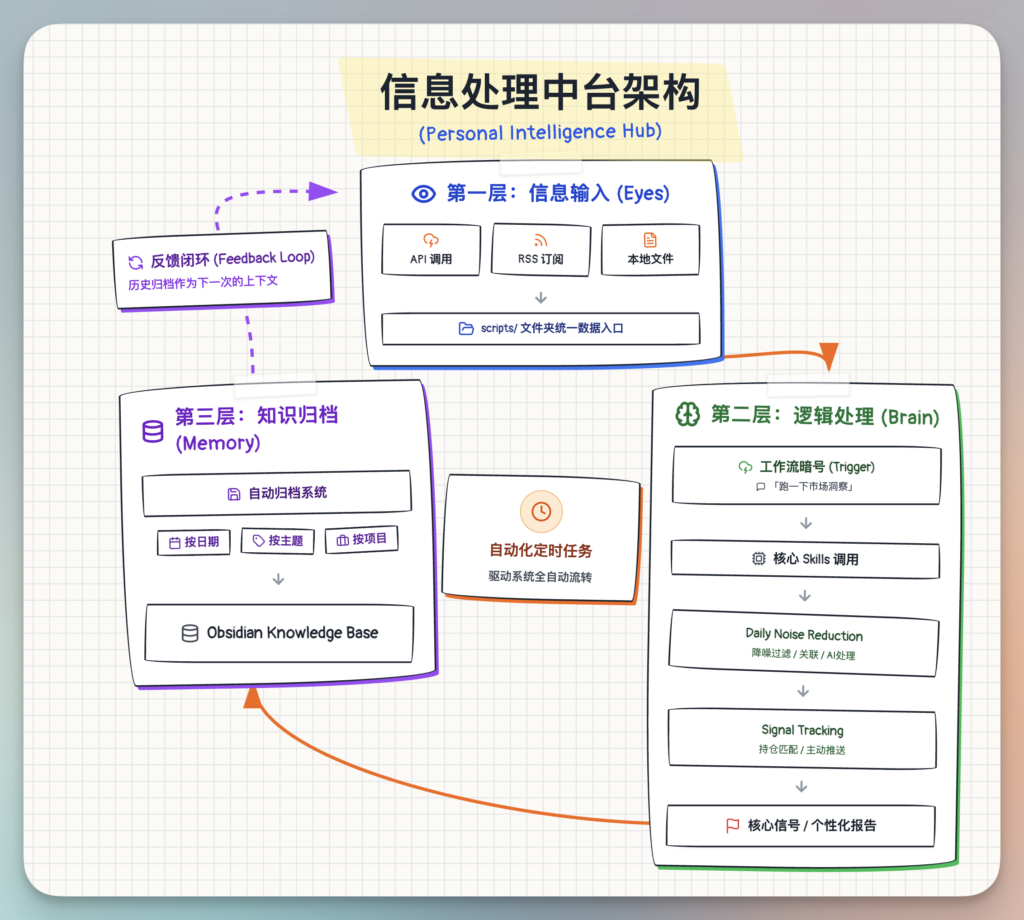

核心理念:AI 的本质不是生成内容,而是处理和调度信息的逻辑中枢

GitHub 开源地址:YMOS

如果(你的agent)无法访问github:可以点下方(Download)下载压缩包,然后解压后使用;

💡 核心洞察:从「人找信息」到「信息找人」

传统工作方式的问题:

你 → 刷信息 → 手动筛选 → 整理笔记 → 忘记在哪里

YMOS 三层架构的工作方式:

数据源 → 自动抓取 → AI 降噪关联 → 个性化推送 → 自动归档

↑ ↓

└──────── 闭环反馈 ────────────┘

关键差异:你不再被动刷信息,而是主动配置规则,让 AI 替你监控、筛选、推送。

🏗️ 三层架构拆解

第一层:信息输入

核心任务:通过配置化的脚本,自动从各种数据源拉取内容到本地。

以投资场景为例:

# 方式 A:API 数据获取(推荐,数据更结构化)

python3 scripts/fetch_data_api.py 1 --output data.json

# 方式 B:RSS 免费订阅(开箱即用)

python3 scripts/fetch_rss.py 1 --output data.json

脚本放哪里:统一放在 scripts/ 文件夹,便于管理和调度。

其他场景如何适配:

- 学术研究 → 替换为 arXiv API / PubMed RSS

- 产品经理 → 替换为 Product Hunt API / 竞品官网 RSS

- 内容创作 → 替换为微博热搜 API / 知乎热榜 RSS

💡 核心不变:通过配置化的脚本自动拉取

💡 核心可变:API endpoint / RSS 订阅源

第二层:逻辑处理

核心任务:通过「工作流暗号」触发处理逻辑,调用不同的 Skills 对数据进行降噪、关联、分析。

什么是工作流暗号?

在 OpenClaw 对话中说一句自然语言,触发预设的处理流程。

投资场景示例:

你说:跑一下市场洞察

AI 自动执行:

1. 读取 scripts/ 抓取的原始数据

2. 调用 P13 市场扫描 Skill

3. 降噪:几十条信息 → 3-5 个核心信号

4. 生成洞察报告并存档

5. 在对话中输出完整 Markdown

你说:跑一下投资雷达

AI 自动执行:

1. 读取最新市场洞察报告

2. 读取上一份投资雷达(连续跟踪)

3. 结合你的持仓和关注偏好(配置在个人文件中)

4. 分析信号演变:哪些强化?哪些证伪?新信号?

5. 主动推送相关信号:"中东电网新闻 → 关联你跟踪的电力板块"

核心体验:不是你去找信息,是信息主动找你。

工作流触发方式:

- 手动:在 OpenClaw 说暗号

- 定时任务:设置每天自动运行(如每天早上 8 点)

- 事件触发:某个条件满足时自动运行(高级用法)

其他场景如何适配:

| 场景 | 第二层处理逻辑 | 暗号示例 |

|---|---|---|

| 学术研究 | 文献综述生成 + 方法论提取 | “跑一下文献综述” |

| 产品经理 | 竞品功能对比 + 趋势分析 | “跑一下竞品对比” |

| 内容创作 | 选题关联 + 热度分析 | “跑一下选题雷达” |

第三层:知识归档

核心任务:处理完的内容自动归档到本地知识库,按时间/主题/项目分类。

为什么需要归档?

- 历史数据是未来决策的基础:上期雷达的信号追踪,需要对比本期验证

- 防止信息遗忘:AI 生成的报告不会因为对话刷新而丢失

- 形成反馈闭环:归档的数据成为下一轮输入的来源

投资场景示例:

市场洞察报告存档路径:

OpenClaw/市场洞察报告/Internal_Report/2026-02/2026-02-12_Internal_Report.md

投资雷达存档路径:

OpenClaw/ 我的持仓与关注点和投资偏好/ai建议/投资雷达_2026-02-12.md

原始数据存档路径:

OpenClaw/市场洞察报告/Raw_Data/2026-02/financial_data_20260212.json

其他场景如何适配:

| 场景 | 归档示例 | 反馈用途 |

|---|---|---|

| 学术研究 | 按主题归档文献综述 | 追踪研究前沿演变 |

| 产品经理 | 按产品归档竞品对比 | 功能迭代趋势分析 |

| 内容创作 | 按类别归档选题素材 | 热点周期复盘 |

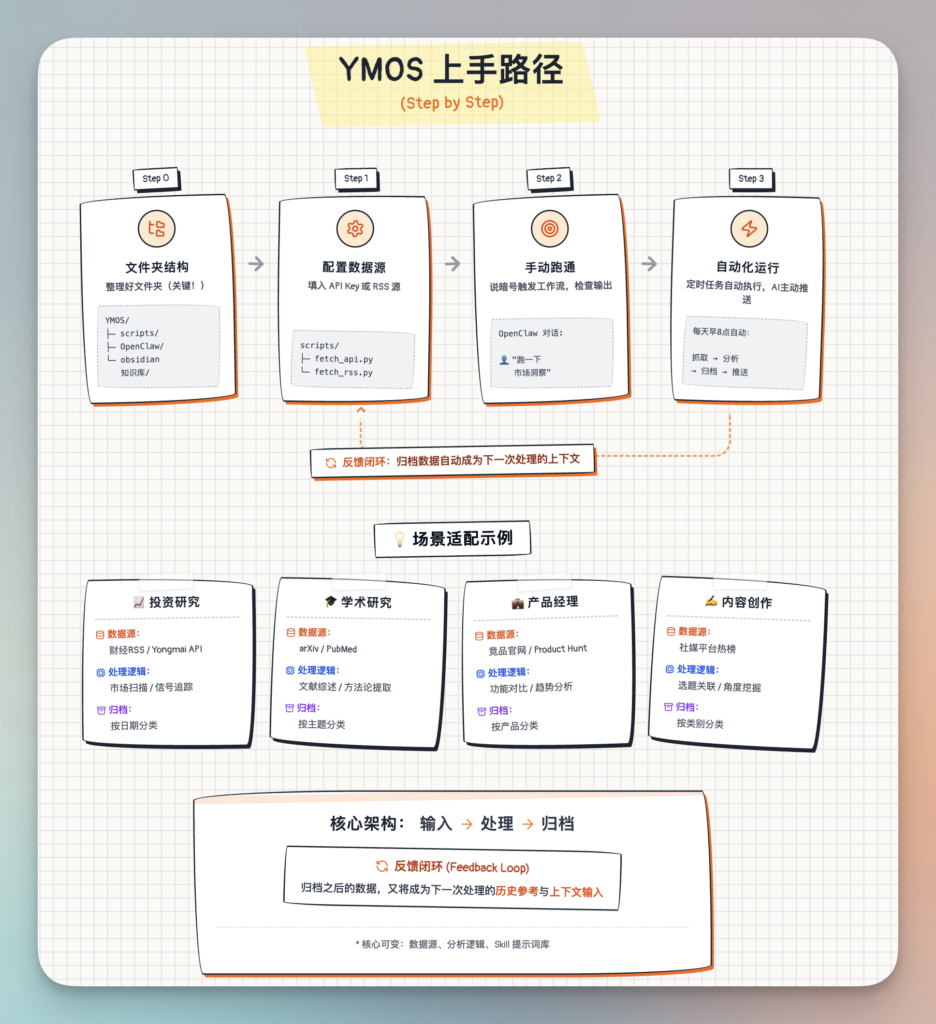

🚀 上手路径(从 0 到 1)

Step 0: 理解路径

文件夹结构整理

↓

手动跑通工作流暗号

↓

通畅后挂上定时任务

↓

AI 自动跑完推送结果

💡 关键洞察:第一步「整理文件夹结构」听起来很土,但这是把 OpenClaw 从聊天工具变成调度中台的关键。

Step 1: 克隆仓库

git clone https://github.com/Evan-XYZ/YMOS.git

cd YMOS

Step 2: 配置数据源(投资场景示例)

投资场景示例配置:

📡 投资场景“数据燃料”选择指南

对于投研系统,数据输入(Eyes)的质量和颗粒度直接决定了 AI(Brain)的分析深度与 Token 消耗。为了适应不同用户的系统架构需求,本仓库支持以下三种级别的数据接入,请根据需要客观选择:

🟢 方案一:免费获取“宏观成品”(开箱即用)

使用勇麦博客每日跑好的合规版市场洞察文章 RSS,。

Yongmai 市场洞察 RSS Feed地址:

https://yongmai.xyz/category/daily-research/feed/- 无需配置,scripts/fetch_rss.py 已默认配置 Yongmai 市场洞察 RSS Feed

- 测试运行:

python3 scripts/fetch_rss.py 1

- 优势:零门槛,极低的 Token 处理成本(AI 只需阅读总结),适合只想快速跑通系统闭环、掌握宏观趋势与跟踪主要市场事件的用户,文章示例 。

- 局限:出于公开博客的合规要求,此源为“脱敏版”,一定程度上避免了具体消息源数据中个股的提及,无法支撑 AI 进行的深阶策略挖掘。

🟡 方案二:免费获取“原始材料”(极客折腾)

自行配置市面上的公共财经 RSS 源(勇麦整理的 28 个优质 RSS 列表:获取地址)。

RSS_SOURCES = {

"市场洞察": "https://yongmai.xyz/category/daily-research/feed/",

"科技新闻": "https://techcrunch.com/feed/",

"宏观经济": "https://your-macro-source.com/feed/",

}- 配置方式:将选中的源填入

scripts/fetch_rss.py中,需自行编写并发抓取逻辑。 - 优势:信息源完全自主可控,覆盖面极广,适合时间充裕、喜欢泛读或想自己训练 AI 降噪脚本的硬核玩家。

- 局限:未经加工的原始网页含有海量非投资类噪音(广告、娱乐新闻等)。直接喂给大模型需要巨量 Token 算力;且需自行处理部分顶级外媒的网络抓取限制与搭建RSSHUB进行数据结构化处理。

🔴 方案三:付费获取“高级燃料”(深度直达)

接入勇麦云端每日自动抓取、清洗降噪后的结构化中文净数据 API(API 详情与获取)。

- 编辑

scripts/fetch_data_api.py - 将

API_KEY = ""改为你的 Key - 测试运行:

python3 scripts/fetch_data_api.py

- 优势:格式极其纯净(按投资主题分类的 Markdown),保留了原始新闻的来源与机构情绪,保持高信息密度的同时又不会消耗过多后续处理的token。拥有极高的策略改装潜力,让你可以写自己的激进 Prompt,把每一分 Token 都用在寻找真实的 Alpha 上,实现系统的零摩擦对接。

- 局限:这是一个需要付费订阅的商业接口服务。

Step 3: 填写个人配置

编辑以下文件(投资场景模板),以便AI可以根据你的个人偏好进行后续的自定义风格的信息处理与推送,也可以将这些信息保存到你的agent的user.md文件中:

OpenClaw/ 我的持仓与关注点和投资偏好/我的持仓.md– 你的持仓明细OpenClaw/ 我的持仓与关注点和投资偏好/我的投资状态卡.md– 风险偏好、策略定位OpenClaw/ 我的持仓与关注点和投资偏好/我的关联偏好.md– 关联规则(哪些新闻跟你的持仓相关)

💡 其他场景用户:修改这些配置文件为你的关注点(研究方向、监控对象、关键词等)

Step 4: 手动跑通工作流

在 OpenClaw 对话中说:

跑一下市场洞察

观察 AI 是否正常读取数据、分析、生成报告、存档。

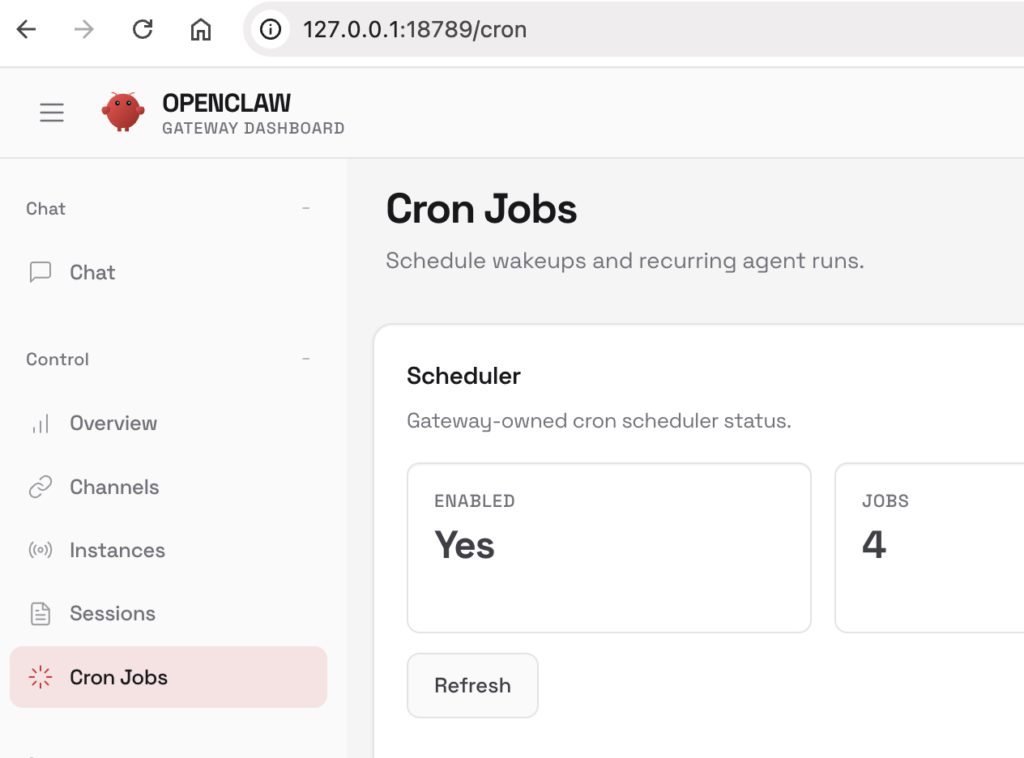

Step 5: 设置定时任务(可选)

当手动流程跑通后,可以在龙虾设置每天自动运行。

配置方法也很简单,直接告诉龙虾你需要定时运行什么什么,它会引导你搞定;

🎨 个性化配置建议(投资场景)

1. 调整数据源

💡 进阶插件接入:除了上述文本资讯,你还可以考虑为你的系统集成金融数据 API,丰富系统的数值判断能力:

- 金融资产实时价格/财报 API:Finnhub

- 社交情绪监控:Twitter/X API

2. 定制关联规则

编辑 我的关联偏好.md,告诉 AI 哪些新闻跟你的持仓相关:

### 某新能源车企

**直接关联**:

- 季度盈利指引、毛利率变化

- 月度交付数据

- 新能源补贴政策

当 AI 扫描到这些关键词时,会主动推送:

"检测到 XX 发布 Q1 盈利指引超预期 → 关联你的持仓 [股票名]"

3. 调整 Skill 提示词

YM-TIB-SKILL/references/ 目录下有 P1-P15 的投资分析提示词:

- P1 Genesis:建立个股基石档案

- P5 FOMO Killer:买入决策审计

- P6 Profit Keeper:卖出决策审计

- P13 Market Scanner:市场扫描降噪(生成市场洞察报告用)

你可以修改这些提示词,调整分析逻辑。

💡 通用性:换个数据源就变成别的东西

核心不变:输入 → 处理 → 归档 → 反馈

核心可变:数据源、分析逻辑、Skill 库

| 你的工作 | 第一层改什么 | 第二层改什么 | 价值 |

|---|---|---|---|

| 学术研究 | RSS → arXiv / PubMed | 市场扫描 → 文献综述 | 自动跟踪前沿 + 方法论提取 |

| 产品经理 | RSS → 竞品官网 / Product Hunt | 信号追踪 → 功能对比 | 竞品情报自动化 + 趋势分析 |

| 内容创作 | RSS → 微博热搜 / 知乎热榜 | 持仓关联 → 选题关联 | 热点捕获 + 多角度挖掘 |

🔧 常见问题

Q: 我不懂投资,这套系统对我有用吗?

A: 有用。YMOS 是通用信息处理中台,投资只是示例场景。你只需要:

- 保留三层架构思想

- 替换

scripts/中的数据源脚本 - 重写「工作流暗号」中的处理逻辑

- 调整 Skill 库为你的领域专业提示词

Q: 必须用 OpenClaw 吗?

A: OpenClaw 在这个架构中扮演「调度中心」的角色,负责:

- 调用本地脚本

- 管理文件读写

- 执行工作流暗号

- 归档 AI 生成的内容

如果你用其他 AI Agent 框架(如 AutoGPT、LangChain),可以参考 YMOS 的架构思想,用对应工具实现。

Q: 数据安全吗?

A: 所有数据都在你的本地,不上传到任何第三方服务器。API Key 也只存在你本地的脚本中。

Q: 定时任务会消耗很多 API 调用次数吗?

A: 以投资场景为例,每天运行 1 次 = 1 次 API 调用。Yongmai API 订阅通常为 100 次/月,足够日常使用。你也可以用免费的 RSS 方式。

Q: 我该如何开始?

A: 建议路径:

- 先用投资场景跑通(即使你不投资,也能理解架构)

- 跑通后,思考如何迁移到你的工作场景

- Fork 仓库,修改数据源和处理逻辑

- 遇到问题,实际AI就是你的最好的帮手,从安装到执行到改BUG。所以其实只需要把文档发给AI自己,然后配合AI一步步解决就好了

📚 延伸阅读

- GitHub 仓库:YMOS – Star ⭐ 支持开源/ YMOS文件夹手动下载

- API 配置指南:Yongmai 市场 API

- 28 个金融 RSS 源:TIB RSS 清单

- 视频演示:抖音搜索「勇麦」

🎯 最后一句话

YMOS 不是教你如何「让 AI 写报告」,而是教你如何构建一套自动化的信息处理管道,让 AI 替你监控、筛选、推送,把时间留给真正需要人类思考的决策环节。

投资场景验证了这套方法论的可行性——如果 AI 能在信息噪音最大、标准最严苛(盈亏)的投资领域帮到你,那它在学术、产品、创作等领域更是降维打击。

思想开源,欢迎拿去改,也欢迎交流你的「智力创造」,勇麦邮箱:[email protected] 。

by 勇麦 | 2026-02